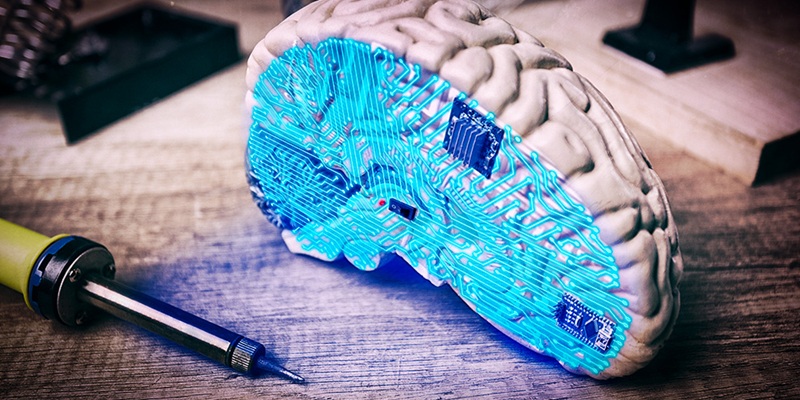

Российские эксперты рассказали, как могут угрожать популярные нейросети

Мобильные новости

17-05-2025

К примеру, ранее в Microsoft запретили использовать своим пользователям китайскую нейросеть DeepSeek, что по мнению Ильи Гусева, специалиста по машинному обучению, является вполне нормальной мировой практикой.

К тому же DeepSeek - не единственный нейросетевой сервис, находящийся под запретом. При этом автор подметил, что сама по себе ИИ-модель не представляет опасности.

А еще он заметил, что нейросетям типа ChatGPT можно доверять задачи, которые не содержат чувствительных данных, тогда угрозы отпадут сами по себе.

Однако эксперт «Лаборатории Касперского» Дмитрий Аникин считает, что нейросети все же представляют опасность из-за возможных ошибок в процессе разработки сервисов, либо кибератак.

Помимо российских специалистов, свое опасение ранее выразил Папа Римский Лев XIV.

Он рассказал, что искусственный интеллект по его мнению является большой проблемой человечества ввиду того, что ИИ создает огромные трудности для защиты труда человека, его достоинства и справедливости.

Подписывайтесь на нас в Telegram и ВКонтакте.

Яна Щербинина, 25 лет

Журналист, ньюсмейкер, переводчик

Любит только все самое свежее! Занимается поиском, проверкой, переводом и публикацией актуальных новостей. Следит за разделом «Новости».

Информация полезна? Расскажите друзьям

Нашли в тексте ошибку?

Выделите её, нажмите Ctrl + Enter, и мы все исправим!

Похожие материалы

Анекдот дня

— А у меня телефон, похоже, зэк-рецедивист! — А чо? — Да садится постоянно...

Загрузить ещеПоделиться анекдотом:

Факт дня

Всемирно известные линейки смартфонов Nexus и Pixel компании Google с «чистой» операционной системой Android выпускаются сторонними производителями.

Больше подробностейПоделиться фактом:

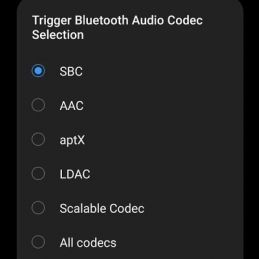

Совет дня

В некоторых версиях Android возможны проблемы с воспроизведением видео, использующего технологию Flash. Решением может стать установка альтернативного барузера.

А почему?Поделиться советом:

Цитата дня

Поделиться цитатой:

Угадаешь? Тогда ЖМИ!

Советуем глянуть эти материалы

Какое слово закрашено?

мда уж, не угадал!

ого, а ведь верно!

- Женой

- Умнее

- Интереснее

- Красивее